上周帮一个音乐学院的朋友调试新买的AI作曲插件,他盯着电脑屏幕看了半天,突然冒出一句:”这玩意儿写出来的和声进行,比我苦学三年作曲理论编的还流畅…”其实现在很多专业音乐人都在偷偷用这些工具,只是没人明说罢了。

音乐科技正在改写作曲的游戏规则

去年给某音乐综艺做编曲时,导演临时要求把民乐改编成电子风,留给我的时间只有48小时。靠着Melodyne和Cubase的音频转MIDI功能,硬是把二胡独奏转化成了赛博朋克风格的电子lead,节目播出后这段改编还上了热搜。传统作曲讲究”灵感来了再动笔”,但现在:

AI和声生成器:像AIVA、Amper这样的工具,输入情绪关键词就能生成专业级的和声框架。有次我用”忧郁的雨天”当提示词,它给出的和弦进行居然很接近Radiohead的《No Surprises》

智能编曲插件:Soundtrap能根据主旋律自动生成鼓点、贝斯线,比很多入门制作人编得更有律动感。测试过它的乡村风格模板,生成的班卓琴分解和弦简直能以假乱真

云端协作系统:通过Splice和BandLab,我在北京做的demo,洛杉矶的混音师半小时后就能收到带自动标注的工程文件,比发邮件传附件靠谱多了

最近帮某游戏公司做BGM时更夸张,他们的音频总监直接要求:”先用Mubert生成20个不同情绪的电子乐片段,我们再人工筛选优化。”这工作流程放五年前会被音乐学院教授骂死,但现在行业里都这么干。

作曲理论没过时,但得学会新玩法

别误会,我可不是说传统乐理不用学了。去年给周杰伦演唱会弦乐组写谱时,那些转调技巧和离调和声,AI目前还是处理不好。但现在的聪明做法是:

把科技当参谋而不是替身:就像我写电影配乐时,会先用Orb Composer生成8个小节的动机,然后自己用对位法发展成完整乐章。这工具的和声数据库是基于肖斯塔科维奇全集训练的,比我自己翻总谱快多了

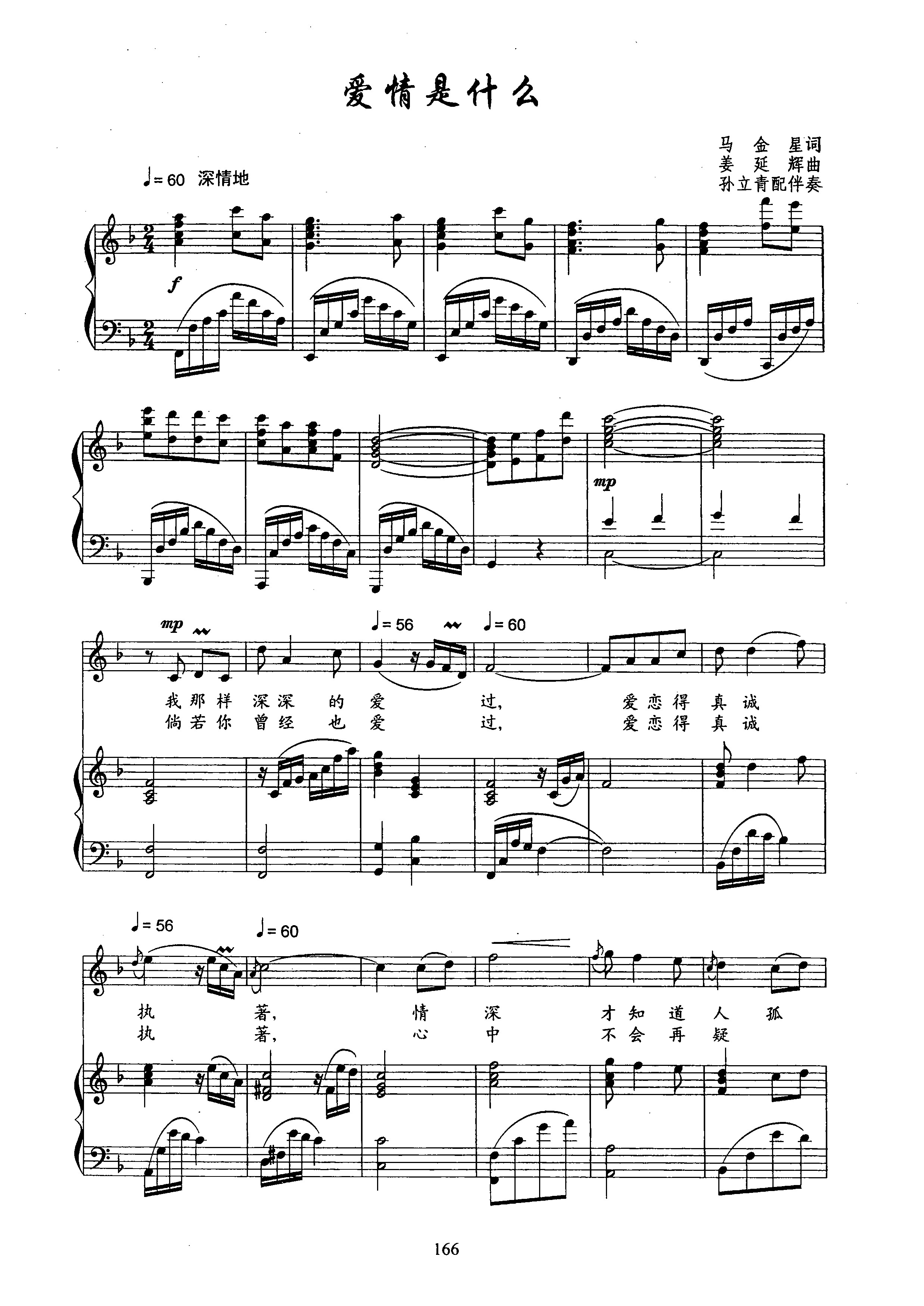

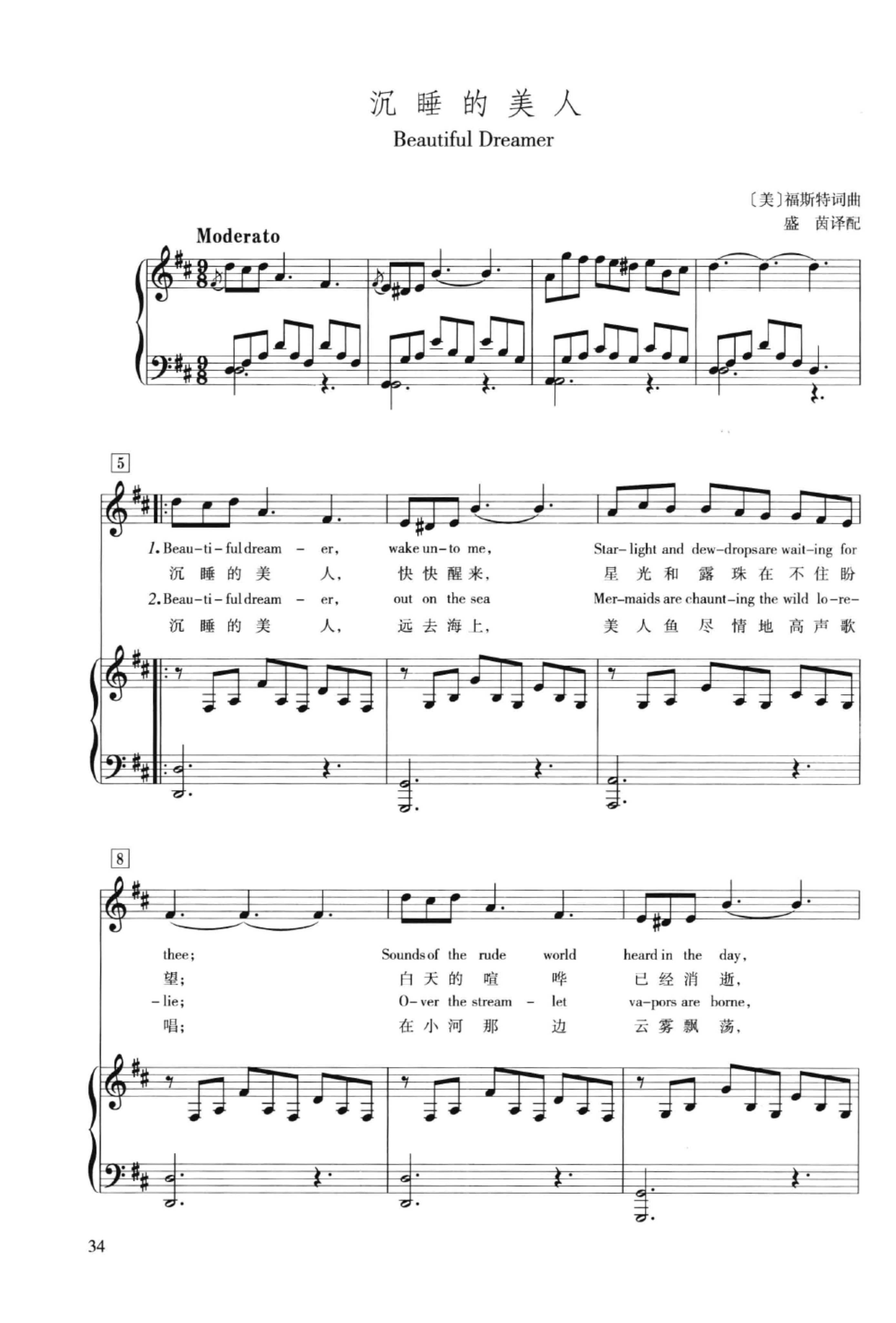

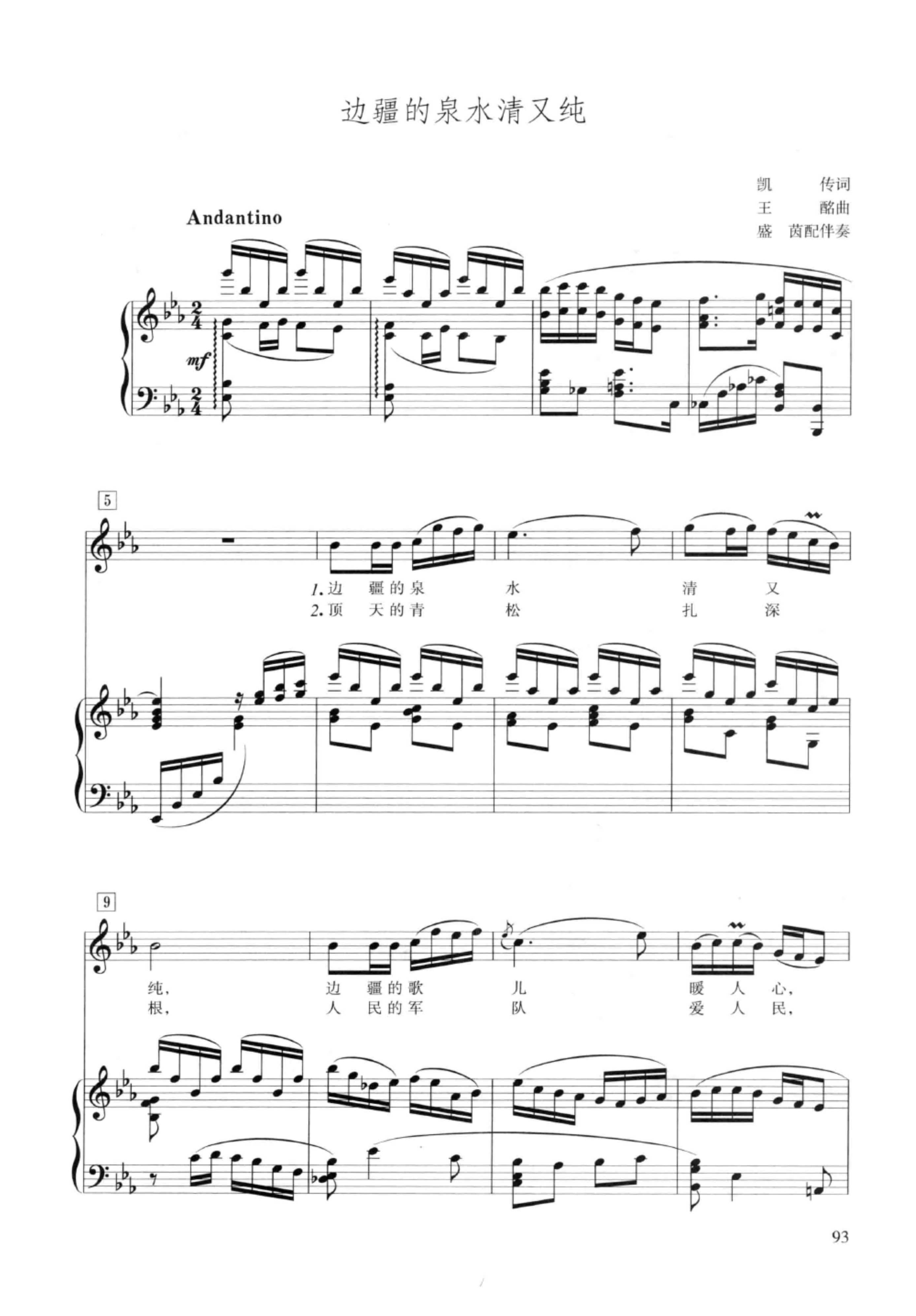

耳朵训练更重要了:有了iZotope的AI母带工具后,反而要更警惕”听起来很专业”的假象。我养成了个习惯——所有AI生成的段落都要用钢琴缩谱检查,不然很容易被华丽的音色欺骗

实时反馈系统:现在用ScoreCloud记谱,哼唱旋律就能自动转成五线谱,错误率比音乐系学生的听写作业还低。但关键是要会判断哪些”自动修正”其实破坏了原本的创作意图

有个很有趣的现象:央音作曲系去年新增的《计算机音乐创作》选修课,报名人数是传统《管弦乐配器法》的三倍。我认识的一个教授说,现在学生交作业,经常是Logic工程文件附带一份Sibelius打的谱,再用Overture生成不同乐器的分谱——整套流程放在2000年够开个小型制谱工作室了。

音乐人必备的5个科技外挂

上个月帮某流量歌手制作单曲,从写歌到发行只用了72小时,靠的就是这套组合拳:

LANDR的自动母带:比传统工作室便宜80%的价格,质量足够应付流媒体平台。有次我故意把故意做砸的混音丢给它处理,出来的动态范围居然符合EBU R128广播标准

Waves的Clarity Vx:现在录人声根本不用挑棚子了,这插件能分离出录音环境中的空调噪音,效果比NS1降噪器强不止一个量级。上次在快捷酒店录的demo,处理后听起来跟在Abbey Road录的似的

Soundful的版权检测:上传旋律片段就能比对各大平台的歌曲库,避免无意识抄袭。有回它提示我的前奏和某韩团歌相似度达68%,赶紧改了和弦转位才躲过一场官司

最魔幻的是最近接的活——某手游公司要求用Boomy生成500条不同长度的电子乐循环片段,说是要用来做玩家战斗时的实时动态配乐。放在十年前,这种需求得雇个作曲团队干半个月,现在三台电脑挂机一晚上就搞定了。

还没有评论呢,快来抢沙发~